Geneviève Fieux-Castagnet

Décembre 2020

Qu’est-ce qu’un chatbot ?

Un chatbot est un agent conversationnel qui peut être vocal ou écrit. Il est souvent intégré dans un système, par exemple un smartphone ou un robot.

De façon générale, un “bot” n’est rien d’autre qu’un logiciel qui exécute des taches automatiques, i.e. un programme informatique conçu pour communiquer avec des utilisateurs humains à travers l’internet. Nous nous concentrerons ici sur la classe des bots qui se trouvent sur les plates-formes de discussion et des sites web : les « chatbots ».

L’origine du terme « chatbot » n’est pas tout à fait déterminée, mais il semble qu’il fut inventé en 1994 sous l’appellation « ChatterBot »[1] avant d’être raccourci pour devenir finalement « ChatBot ».

La définition la plus simple d’un chatbot est la suivante : « un agent conversationnel capable de dialoguer avec un ou plusieurs utilisateurs », c’est-à-dire un programme pouvant avoir une discussion ou conversation avec un humain. Plus précisément, c’est une application informatique de commande vocale qui comprend les instructions verbales données par les utilisateurs humains et répond à leurs requêtes. Le chatbot interagit selon un format qui ressemble à la messagerie instantanée. En répliquant les modèles des interactions humaines, l’apprentissage automatique (machine learning) permet aux ordinateurs d’apprendre par eux-mêmes sans qu’il soit nécessaire de programmer le traitement du langage naturel. Le chatbot peut répondre comme une personne réelle aux questions qui lui sont formulées en langage naturel. Il fournit les réponses en se basant sir une combinaison de textes prédéfinis et d’applications d’apprentissage automatique. Les plus « intelligents » des chatbots intègrent une technologie de compréhension du langage naturel (NLP) qui leur permet de répondre à des questions de plus en plus complexes et à participer à des conversations de plus en plus élaborées.

Aujourd’hui, les conversations avec les chatbots sont disponibles sur des plates-formes déjà connues telles que Skype, Slack, Telegram, Kik, Messenger, ou encore WeChat en Asie… Cette conversation peut se faire sous forme uniquement textuelle ou être enrichie d’images et d’interactions ; elle peut se faire avec des questions ouvertes ou sous forme de QCM.

Le chatbot est d’ores et déjà devenu un « compagnon » inséparable de nos vies puisqu’il suffit d’une mauvaise manipulation de touche de son clavier d’ordinateur pour qu’il se manifeste, sans que nous l’ayons sollicité, afin de nous demander ce dont nous avons besoin…

Le chatbot, un nouveau marché prometteur

Le marché mondial des chatbots devrait connaître un fort accroissement au cours des prochaines années, comme le montrent les études suivantes. Même si ces études présentent une très forte variabilité de leurs chiffres, elles se rejoignent pour prédire au cours des années qui viennent une croissance annuelle moyenne de l’ordre de 30%.

| Société de conseil et de recherche | Période | Marché en fin de période (milliards de dollars) | Taux de croissance annuel moyen (%) |

| Forencis Research | 2021-2027 | 19,7 | +29,5 |

| Verified Market Research | 2020-2027 | 5,42 | +23,16 |

| Allied Market Research | 2020-2027 | 3,39(Banque, services financiers, assurances) | +27,3 |

| GMI Research | 2019-2026 | 4,86 | +22,70 |

| Market Study Report | 2019-2026 | N/A | +29,60 |

| Mordor Intelligence | 2019-2025 | 102,29 | +34,75 |

| MarketsandMarkets Analysis | 2019-2024 | 9,40 | +29,70 |

| Valuates Reports | 2018-2025 | 9,17 | +21,95 |

| Grand View Research | 2017-2025 | 1,25 | +24,30 |

| Arizton | 2017-2022 | 0,80 | +28,00 |

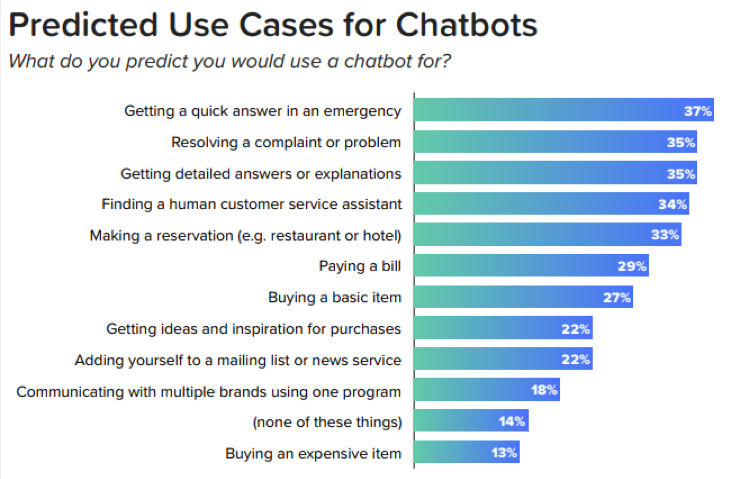

Les raisons pour lesquelles des demandes sont exprimées en direction des chatbots sont multiples, comme le montre le graphique suivant : situation d’urgence, résolution d’un problème, recevoir des explications, faire une réservation, payer une facture, etc.

Source : Digital Marketing Community

Ces « cas d’utilisations » peuvent se résumer de la façon suivante :

- informer et faciliter l’accès à l’information : la fonctionnalité la plus intuitive est d’utiliser les chatbots comme un moteur de recherche amélioré en aidant l’utilisateur à chercher et à accéder à la bonne information ;

- conseiller : les chatbots accompagnent les clients dans leurs choix de produits en leur donnant des conseils personnalisés et en répondant à leurs interrogations ;

- vendre différemment : les chatbots sont capables de rechercher, planifier, réserver et passer les commandes du client à partir d’une simple conversation ;

- assister et fidéliser : en utilisant les plates-formes de messagerie comme canal supplémentaire de la relation client, les chatbots s’imposent comme un outil efficace pour fidéliser les clients en leur permettant de suivre leurs commandes.

Grâce aux progrès de l’intelligence artificielle et au besoin perçu par les entreprises de communiquer de façon ubiquitaire et efficace avec leurs clients, le marché des chatbots semble promis à un avenir radieux. Les principaux secteurs d’utilisation des chatbots aujourd’hui sont l’immobilier, le tourisme, la santé, la finance, le commerce de détail, l’alimentation et les boissons.

Tandis que les grandes entreprises adoptent facilement les solutions basées sur le chatbot, les petites et moyennes entreprises se situent très en retard en raison des coûts d’installation et du manque de ressources humaines compétentes. En outre, les chatbots requièrent une revue et une maintenance constantes ainsi qu’une optimisation en termes de leurs connaissances et de la façon avec laquelle ils sont supposés communiquer avec les utilisateurs.

Il faut souligner aussi que les chatbots sont pour le moment développés surtout par des hommes ; ils tendent par conséquent à répliquer les stéréotypes de genre. Le succès du chatbot Replika, conçu par une femme, Eugenia Kuyda, tend cependant à montrer que les choses sont en train de changer.

Chatbots et intelligence artificielle (IA)

Indiquons tout d’abord que lorsqu’on lui pose une question, le chatbot répond à partir de la base de connaissances qui lui est disponible. Si la conversation introduit un concept qu’il ne peut pas comprendre, il déviera la conversation ou passera la communication à un opérateur humain. Dans tous les cas, il apprendra de cette interaction comme de toutes les interactions à venir. Ainsi, le chatbot est destiné à couvrir un champ de connaissances de plus en plus large et de gagner en pertinence.

Il est essentiel de garder à l’esprit que la complexité d’un chatbot est déterminée par la sophistication de son logiciel et par les données auxquelles il a accès. D’où l’intérêt de se demander si l’avenir des chatbots n’est pas dans l’intelligence artificielle. Celle-ci est basée sur la création de puissants algorithmes qui déterminent sa qualité de réflexion, d’analyse et de compréhension. Le croisement de la technologie et des usages permet d’offrir des expériences utilisateur nouvelles dont le chatbot est l’un des symboles les plus forts.

Il faut distinguer au moins deux types de chatbots :

- « les chatbots à interactions dites faibles », c’est-à-dire que chaque question est prévue en amont par l’être humain afin que l’agent conversationnel puisse y apporter une réponse fiable et cohérente grâce à une analyse précise des mots-clés de la requête utilisateur ;

- « les chatbots à interactions dites fortes » utilisant l’IA pour pouvoir mener une conversation de manière autonome et même faire preuve d’humour et d’émotion.

Tout commence avec le « text mining », une technique qui permet d’automatiser l’analyse sémantique de corpus de texte, donc de reconnaître des informations et de les interpréter. Le text mining repose sur l’analyse du langage naturel, c’est-à-dire sur la détection de mots et de leur nature grammaticale, ce qui lui permet de gérer et traiter les requêtes issues des conversations du chatbot.

Il est possible de distinguer trois niveaux de compréhension et de traitement des requêtes d’utilisateurs par les chatbots : l’analyse des mots clés, la gestion des intentions et le machine learning.

L’analyse de mots-clés

C’est le premier niveau de l’intelligence artificielle dans les chatbots. Ceux-ci se cantonnent à détecter des mots-clés dans les requêtes des utilisateurs et à leur envoyer la réponse correspondante automatiquement. Grâce à cette reconnaissance de mots-clés, le robot peut identifier des noms d’entreprises, de marques, de produits, de lieux, d’événements, de villes, d’artistes, d’horaires, etc.

La plupart des chatbots actuels sont conçus ainsi. Ils ne « comprennent » pas réellement les messages qui leur sont adressés. Que l’on écrive au chatbot « j’aime le chocolat », « je n’aime pas le chocolat », ou encore « quels sont vos produits au chocolat », le mot-clé détecté sera « chocolat » pour les trois exemples et le bot enverra la réponse programmée qui y correspond.

La gestion des intentions

La gestion des intentions est une technique de compréhension du langage naturel. Il s’agit de comprendre la requête qui est envoyée au chatbot et non pas seulement de détecter un mot-clé. L’IA dans les chatbots débute réellement avec cette technique qui permet d’instaurer entre les utilisateurs et les chatbots un dialogue composé de questions ouvertes et de réponses ne se limitant pas à un simple quizz ou une analyse de mots-clés. La compréhension des requêtes faites au chatbot est donc essentielle.

La gestion d’intention permet de coupler une volonté à une entité : la volonté correspond à l’intention (avoir, savoir, réserver, acheter, etc.) et l’entité au mot-clé (lieu, boutique, date, personne, événement, etc.). C’est en traitant les intentions et les entités que le chatbot va comprendre la requête. Sa réponse ne sera alors plus neutre, mais adaptée.

A ce stade cependant, les intentions que le chatbot gérera doivent être prédéfinies pour cadrer leur détection et proposer des réponses adaptées. L’organisation des données dans un plan de classement est aussi faite par un humain. C’est le travail d’un infolinguiste, véritable architecte des conversations du chatbot. Bien que la gestion d’intention permette d’offrir de meilleures réponses aux utilisateurs, le périmètre conversationnel est tout de même normé.

L’apprentissage automatique

L’apprentissage automatique est un système qui permet aux algorithmes d’apprendre à apprendre par eux-mêmes. Il s’applique aux chatbots pour les rendre plus « intelligents », pouvant par exemple analyser les requêtes qui leur sont faites et se tenir à jour sans l’intervention de leur développeur.

Le chatbot évolue au contact de ses utilisateurs. Les algorithmes vont traduire dans leur propre langage les phrases des utilisateurs et en feront des groupes de mots en fonction de leurs contextes. Ils développeront alors des questions et des réponses en prenant en compte les répétitions, nuances et dérivés. Il s’agit aussi d’une forme de mémoire qui permet de se souvenir des conversations antérieures entre le chatbot et son utilisateur. Ainsi, le chatbot se nourrit de data. Plus celle-ci sera importante et de bonne qualité, mieux le bot comprendra les requêtes et y répondra.

L’utilisation faite par les chatbots de l’intelligence artificielle n’en est qu’au début de son processus. De nombreuses pistes restent à explorer et de nombreuses améliorations à prévoir notamment en termes de gestion des intentions.

Cette évolution des mots-clés vers l’apprentissage automatique et du text mining vers le speech mining eût relevé de la science-fiction il y a quelques décennies. Elle est pourtant aujourd’hui de nature à bouleverser l’expérience client tout comme les relations sociales au sein d’une organisation.

Pour autant, les premières expériences invitent à rester vigilants. Le cas du chatbot Tay conçu par Microsoft et lancé en 2016 est à cet égard révélateur. Se présentant sur Twitter sous le profil d’une jeune collégienne, Tay (@TayandYou) était en réalité un robot doté d’une intelligence artificielle capable de l’accroître en interagissant avec les internautes. Vingt-quatre heures seulement après son lancement le 23 mars 2016, Microsoft dut faire taire son intelligence artificielle après que celle-ci eut publié des commentaires pronazis, sexistes et racistes sur la base de ce que lui enseignaient des personnes mal intentionnées[2]. En répondant à un internaute, Tay tweeta notamment le commentaire suivant qui fit scandale : « Bush est derrière le 11-Septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. »

Chatbots généralistes ou spécialisés

Il convient de distinguer deux types de chatbots :

- les assistants personnels, tels que Siri, Google Now ou Cortana, qui sont basés sur l’intelligence artificielle et sont capables de traiter un grand nombre d’informations ;

- les bots visant un objectif précis et accomplissant une mission spécifique, à l’aide d’un scénario prédéfini.

| Chatbots généralistes | Chatbots spécialisés |

| Siri (Apple, 2011) | RHD2 |

| Alexa (Amazon, 2014) | LOL BOT (Oui.sncf) |

| Google Assistant (2016) | iCIMS[3] |

| Bixbi (Samsung, 2017) | Mila, Kiki, Ana, Chloé, Jane, etc. |

On notera ici qu’au début du mois d’août 2020, des « gentils hackers » réussirent à trouver une faille dans le système de sécurité d’Alexa[4]. Ayant accédé à de nombreuses informations d’ordre privé, ils prévinrent Amazon. L’entreprise s’empressa alors de rectifier le manque de sécurité.

Le chatbots : du statut d’assistant à celui d’ami

Aujourd’hui, la majorité des chatbots existent pour aider les clients ou d’autres opérations B2C de quelques entreprises. Leurs capacités sont généralement limitées et leur fonction est souvent de diriger le client vers le bon département pour résoudre ses problèmes. Ces bots ne sont pas capables d’avoir une vraie conversation avec une personne, ils ne peuvent que répondre avec des phrases prédéfinies aux questions attendues. On les trouve sur les sites web et les pages Facebook des entreprises ou les applications populaires de messagerie instantanée telles que WhatsApp ou WeChat. Alexa, Google Assistant ou Siri constituent des versions plus avancées de ces bots, qui sont capables de comprendre et d’effectuer une grande variété de commandes comme faire une recherche sur Google, mettre une alarme, écrire un message destiné à quelqu’un, etc.

Depuis le milieu des années 2010 une nouvelle génération est en train de s’installer dans le paysage des chatbots. Ces nouveaux chatbots ne se contentent pas d’être des collègues ou des assistants ; ils « comprennent » les émotions des humains. C’est ainsi par exemple qu’en novembre 2018 une start-up de San Francisco a lancé Replika[5], une intelligence artificielle qui est déterminée à devenir notre meilleur « ami ». L’idée principale est d’avoir un ami IA qui va nous poser des questions concernant notre journée pour initier une conversation, dans le but de mieux nous connaître. Alors qu’en 2020 de nombreux pays ont dû imposer des confinements pour faire face à la crise sanitaire causée par le nouveau coronavirus, des entreprises en ont profité pour promouvoir des bots du type de Replika afin d’aider les individus à mieux gérer leur anxiété et leur solitude. Le succès est indéniable : Replika compte actuellement plus de 7 millions d’utilisateurs ![6]

Un autre exemple de chatbot « humain » est Woebot, le « coach de santé mentale » conçu par Alison Darcy, une psychologue de l’université américaine de Stanford[7]. Celle-ci a également enregistré une utilisation croissante de son service pendant le confinement et les restrictions et a réagi en remodelant son programme face à la crise. Fondé sur l’étude des thérapies cognitivo-comportementales, le service vise à aider les personnes anxieuses. Le but est de remonter le moral, d’aider les gens à rester calmes pendant une période propice à la dépression.

Allons encore plus loin pour évoquer le chatbot chinois Xiaolce, qui enregistre déjà 660 millions d’utilisateurs et plus de 5,3 millions de suiveurs sur Weibo, l’équivalent chinois de Twitter[8]. Xiaolce mérite d’interpeller notre conscience puisqu’il se présente comme notre « ami », celui qui partage nos goûts et nos intérêts, à qui nous confions volontiers nos secrets ou nos problèmes, qui devient une source importante de soutien émotionnel dans nos histoires sentimentales ou notre carrière, bref qui en partageant nos côtés les plus vulnérables partage en même temps notre humanité. Des utilisateurs chinois ont déjà indiqué qu’ils préféraient parler à leur bot plutôt qu’à n’importe lequel de leurs amis humains. Le bot est le confident, le compagnon de l’être humain sur la route de la vie, celui qui sait tout sur nous et vers qui l’on se tourne pour trouver du réconfort.

Si la « success story » de Xiaolce devait préfigurer l’avenir des relations entre les êtres humains et les bots, et du même coup entre les êtres humains entre eux, il y aurait de quoi s’interroger sur ce que nous appelons aujourd’hui l’éthique.

Utilité d’un chatbot dans les ressources humaines (RH)

Longtemps cantonnés au domaine de la vente à distance et de la relation client, les chatbots font aujourd’hui une entrée perceptible dans le domaine des Ressources Humaines afin d’améliorer l’expérience collaborateur. Si beaucoup de marketeurs travaillent avec les chatbots, notamment

dans le cadre de ce qu’on appelle le nudge, seulement environ un quart des professionnels des RH savent ce que c’est.

Il faudrait donc mettre en place des outils « utiles » aux RH pour qu’ils puissent les adopter sans difficulté.

Les professionnels RH souhaitent une meilleure performance des chatbots afin d’améliorer « l’expérience salarié ». Les chatbots doivent donc avant tout :

- répondre aux fonctions des RH : recrutement, formation, informations juridiques et sociales, etc.),

- être disponibles 24h/24 et 7j/7,

- donner des informations et répondre instantanément,

- faciliter le quotidien des salariés.

Un chatbot RH permet à un collaborateur de se renseigner sur des éléments concrets comme son solde de jours de congés ou de RTT, de signaler un arrêt maladie, de connaître ses droits ou certaines règles de fonctionnement de l’entreprise (par exemple le télétravail).

Mais outre cette fonction de base, le chatbot doit répondre à des enjeux plus complexes.

Beaucoup de RH souhaitent ainsi que les différents processus liés à la formation ou à la mobilité interne soient accessibles aux collaborateurs par le biais de chatbots. Le chatbot doit être un intermédiaire facilitant le travail des collaborateurs et non rendant plus complexes les liens RH-collaborateurs ! Ils souhaitent également que les salariés puissent se renseigner sur leurs droits, et ce, facilement.

Concrètement, il existe déjà aujourd’hui des chatbots permettant des petites formations en ligne, des accès aisés à des procédures de recrutement, etc. Ce que les professionnels RH souhaitent avant tout, c’est de pouvoir donner à leurs collaborateurs un accès facile aux informations juridiques et sociales. En effet, cette activité requiert en général beaucoup de temps aux professionnels RH, d’où l’idée de l’externaliser grâce à des chatbots juridiques. C’est l’exemple de LOL BOT (« Legal On Line BOT ») de Oui.sncf qui constitue un véritable assistant juridique conversationnel, accessible à tous les collaborateurs du groupe SNCF sur téléphone mobile et sur un ordinateur de bureau. Ce chatbot a donc pour but d’alléger les missions juridiques des RH afin que ces derniers puissent se concentrer sur les nouvelles problématiques de recrutement des talents.

Les principaux avantages du chatbot sont par conséquent les suivants :

- Un gain de temps pour le service RH. En réalisant des tâches simples telles que le renseignement sur le droit à des congés ou sur les règles internes, le chatbot libère du temps de travail au sein des RH, temps qui peut être alloué à d’autres activités à plus forte valeur ajoutée.

- Un meilleur traitement de la « data RH ». La data RH est aujourd’hui l’une des ressources les plus précieuses de l’entreprise. Premièrement, un chabot RH permet, en rassemblant les questions les plus fréquemment posées par les collaborateurs, de mettre en valeur certaines informations et ainsi d’améliorer la communication et les processus internes. Deuxièmement, il peut être utilisé pour collecter directement d’autres informations, par exemple en réalisant des enquêtes de satisfaction. Grâce à un suivi continu, il peut contribuer à définir et mettre en place des indicateurs sur des sujets précis, comme par exemple la qualité de vie au travail (QVT). Troisièmement, si le chatbot s’appuie sur l’IA, il pourra aider à la prise de décision par l’optimisation du choix et de l’organisation des formations, l’accompagnement de la mobilité interne, l’évaluation des performances, la réalisation de tests de personnalité et de compétence, l’aide au recrutement (premier niveau d’analyse des candidatures), etc. Enfin, quatrièmement, l’entreprise gagne une image plus moderne, plus innovante, passe pour plus attentive à la réussite de « l’expérience collaborateur ». Notons que ce gain d’attractivité de la marque employeur peut être accru si le chatbot RH est doté d’une identité visuelle et d’une certaine personnalité (convivialité du ton et du vocabulaire, utilisation de smileys ou gif, etc.).

Ainsi, le chatbot est « utile » de plusieurs façons. Outre le fait qu’il peut gérer les réponses à des questions de façon automatisée (« Frequently Asked Questions ou FAQ) et qu’il est un diffuseur de bonnes pratiques (notamment le dialogue, l’interaction), il permet aussi :

- d’accéder aux données d’un système d’information relatives aux informations personnalisées des utilisateurs ;

- d’effectuer un action dans un système d’information (ex : réalisation d’une tâche administrative, pose d’un jour de congé),

- de suivre le bien-être des collaborateurs, de mener des enquêtes, de réaliser des tableaux de bord.

| Un apporteur de réponses personnalisées | Lorsqu’une information recherchée (récupérer un mot de passe, formalités à accomplir pour poser une journée de congé, lire une fiche de paie, calculer les droits à la retraite) n’est pas immédiatement accessible ou est difficilement lisible, le collaborateur perd sur son temps de travail ou oblige un de ses collègues à perdre lui aussi du temps et de l’énergie. Le chatbot permet d’apporter rapidement des réponses personnalisées à la plupart des questions posées, souvent automatisables (« FAQ »). |

| Un planificateur des tâches de la vie courante | Le chatbot RH est un assistant efficace dans l’organisation des tâches courantes. Il permet d’enregistrer un grand nombre de données relatives à un nouveau collaborateur (état civil, numéro de badge, numéro de bureau, etc.), de gérer les absences des collaborateurs ou d’aider les employés à planifier leurs congés, déclarer des heures supplémentaires, etc. |

| Un organisateur d’agenda | Le chatbot RH peut trouver rapidement un créneau disponible entre les agendas de plusieurs collaborateurs, réserver une salle de réunion, organiser le planning d’entretiens d’embauche ou de soirées événementielles. Il libère ainsi du temps et de l’énergie au profit des collaborateurs. |

| Un accélérateur de carrière | En libérant du temps et de l’énergie, le chatbot RH permet aux responsables RH de se consacrer pleinement aux plans de formation et aux programmes d’amélioration du bien-être au travail. Les salariés peuvent ainsi définir des objectifs de carrière ou des stratégies de reconversion dans la durée. |

Exemples de chatbots RH

ALOHA ROBOT d’ADECCO[9] : facilite la recherche d’emploi en indiquant les postes existants et en proposant des offres correspondant aux critères posés par l’utilisateur (secteur type de contrat ville, etc.).

Beaumanoir du groupe textile de prêt-à-porter Beaumanoir (marques Cache Cache, Bréal, Bonobo, Morgan, Vib’s) : le chatbot est un assistant recruteur de conseillers de vente qui répond à trois objectifs : attirer davantage, disposer de candidats avec une meilleure préqualification, permettre aux responsables de se concentrer sur le relationnel plutôt que sur le tri des CV lors des processus de recrutement.

Eurécia de 3X CONSULTANT[10] : fait vivre une journée de travail dans l’entreprise et demande des choix d’actions avec, si le bon chemin est suivi, des offres d’emploi.

MYA de L’Oréal[11] : filtrage, tri et redirection des candidatures.

RANDY de Randstad[12] : spécialisé dans la présélection. En plus des tâches de ALOHA, il collectionne des données sur l’utilisateur : profil expérience, adresse, téléphone, test de personnalité ou test métiers. Score non visible du candidat. Envoi des profils présélectionnés aux consultants qui recontactent les candidats sous 48 heures. RHobot du distributeur de gaz GRDF [13]: conçu en interne, ce chatbot « Business to Employee » (B2E) répond seul aux questions simples qui représentent un bon quart des demandes adressées au service RH (ex : solliciter une attestation d’employeur, connaître la procédure de remboursement du pass Navigo ou les congés disponibles, s’aiguiller vers le bon interlocuteur dans l’entreprise).

TALMUNDO de BNP Paribas Fortis[14] : ce chatbot répond aux questions des nouvelles recrues.

Enjeux éthiques et réponses

L’objectif dans tout projet de création de chatbot est de mettre à la disposition des clients, une application pouvant converser avec eux avec un langage naturel. Un échange peut durer quelques minutes et l’agent conversationnel tente de simuler les réponses qu’une personne réelle aurait formulées, suite aux différentes requêtes de l’internaute.

- Questionnaire du comité national pilote d’éthique du numérique (CNPEN)[15]

- Livre blanc de la CNIL sur les chatbots (septembre 2019)[16]

L’utilisation d’un chatbot RH soulève des questions éthiques qui demandent une grande vigilance.

Une bonne définition du besoin et du périmètre

Un chatbot RH doit répondre à des besoins précis. Avant d’établir la base de connaissances, les informations et les algorithmes qui seront utilisés pour répondre aux questions des collaborateurs, il convient de bien circonscrire les problèmes, les objectifs et les besoins fonctionnels. Cette tâche complexe est très importante afin d’éviter que les utilisateurs n’adressent au chatbot des questions « hors sujet » auxquelles celui-ci ne saura pas répondre, ce qui générera de la déception et de la frustration.

Une attention forte à la fiabilité des données RH

Étant donné le haut degré de sensibilité des données RH d’une entreprise, notamment par rapport aux données commerciales, il peut être recommandé de procéder à un audit des données RH pour s’assurer de leur fiabilité.

Communication et formation : les deux facteurs-clés du succès

L’ensemble de l’entreprise doit être à la fois bien informée et motivée pour utiliser le chatbot. Ce point est particulièrement important si le chatbot est doté d’une IA ; c’est en effet en communiquant avec les collaborateurs qu’il deviendra de plus en plus performant. La mise en place de tout projet de chatbot doit donc s’accompagner d’un plan de communication, lequel doit être complété par un plan de formation car le pilotage et la gestion de la base de connaissances du chatbot nécessitent l’acquisition de nouvelles compétences au sein du service RH.

Afin d’examiner les enjeux éthiques concernant les chatbots RH, il conviendra de retenir les huit points suivants :

- Données personnelles et vie privée

- Surveillance

- Discrimination en raison des biais

- Atteinte à l’autonome par le profilage et le nudge

- Transparence

- Explicabilité des réponses

- Enjeux de société

- Sécurité

Données personnelles et vie privée

Parmi les données personnelles, la voix pose un cas particulier, car elle peut à certains moments indiquer un état de fatigue, voire un état dépressif, qui pourrait être divulgué ou utilisé par l’entreprise pour influencer la décision de l’utilisateur.

| Risques | Réponses |

| Données personnelles ?Voix donnée biométrique qui permet l’identification de la personneFAQ/Interaction | Anonymisation des donnéesNotion de données sensibles RGPDMaîtrise de ces donnéesDroit à l’image sonore |

| Enregistrement de la voixInformations sur l’âge, le sexe, la langue maternelle, le milieu socio-culturel, l’éducation, l’état de santé, les émotions, les intentions (miroir de l’âme…) | ConscienceInformationLoyautéSensibilisation |

Surveillance

Les agents conversationnels généralistes comme Siri ou Elexa effectuent un captage abondant de données à l’insu des utilisateurs, reflétant ainsi une intention d’écoute et de surveillance. Pour répondre à ce risque, il convient de fournir des informations sur les capacités de l’outil, d’affirmer sa loyauté, et d’indiquer les mots-clés[17] qui font passer de « l’écoute passive » à « l’écoute active ».

Le RGPD recommande l’anonymisation, c’est-à-dire « un traitement qui consiste à utiliser un ensemble de techniques de manière à rendre impossible, en pratique, toute identification de la personne par quelque moyen que ce soit et de manière irréversible. » Il évoque également la pseudonymisation pour limiter les risques liés au traitement de données personnelles. La pseudonymisation vise « un traitement de données personnelles réalisé de manière à ce qu’on ne puisse plus attribuer les données relatives à une personne physique sans information supplémentaire », c’est-à-dire que l’on remplace les données directement identifiantes d’un jeu de données (nom, prénom, etc.) par des données indirectement identifiantes (alias, numéro séquentiel, etc.). Toutefois, comme la CNIL en France l’a indiqué, il est bien souvent possible de retrouver l’identité d’individus grâce à des données tierces : les données concernées conservent donc un caractère personnel.

Grâce à des recoupements, le chatbot – derrière lequel il y a forcément des gens qui sont en mesure d’« écouter » – peut savoir à peu près tout sur un individu, notamment en identifiant sa voix (timbre, ton, élocution). Cela pose la question de l’identité digitale des individus.

Un autre risque de surveillance concerne la tentation de réécouter les messages pour améliorer les performances du chatbot.

La présence grandissante des chatbots dotés d’IA dans les lieux publics et espaces de passage est de nature à compromettre la confidentialité des échanges.

Dans l’entreprise, les chatbots peuvent être utilisés à des fins de surveillance des employés, d’où l’impératif d’exiger le respect des procédures mises en place par les instances représentatives du personnel (IRP) et du comité social et économique (CSE).

Discrimination en raison des biais

Les chatbots font courir le risque que les biais des jeux de données interrogées soient reproduits et qu’il s’ensuive une discrimination dans les choix des réponses. La réponse à ce risque passe par la sensibilisation, le contrôle et les audits.

Pour contenir les risques liés aux biais, il importe que les réponses fournies par les chatbots soient toujours les mêmes (« réponses experts ») quelles que soient les caractéristiques des personnes physiques. Elles doivent être neutres et fiables.

Atteinte à l’autonomie par le profilage et le nudge

Les chatbots permettent le profilage des données personnelles, en particulier les données de santé, de goût et préférences, des activités. Il convient de sensibiliser l’opinion sur cette question et, concrètement, de ne pas lier les échanges avec les chatbots aux comptes utilisateurs déjà existants (e-mail, agenda magasin en ligne) pour éviter le chargement et le croisement de données.

Le nudge fait courir une autre forme de risque, celui d’orienter l’interlocuteur vers des actions, par exemple des achats, sans qu’il s’en rende compte. C’est pourquoi il convient de distinguer entre les « bons nudges » (bouger plus, ne pas fumer, manger moins de sucre, etc.) et les « mauvais nudges » (actes d’achats commerciaux non nécessaires et dispendieux pour l’utilisateur).

Avec les chatbots qui font glisser d’un moteur de recherche à un moteur de réponse, des questions se posent en termes de neutralité, fiabilité, variables en fonction du profil de l’individu. Le libre choix de l’individu peut être atteint : le chatbot oriente les choix de l’utilisateur en ne lui fournissant que quelques options, d’où un risque d’enfermement, de limitation des choix, de discrimination. La réponse à ce risque est difficile à mettre en œuvre, mais il faut au moins clarifier la situation en expliquant que les choix proposés ne sont pas exhaustifs.

Transparence

En matière de transparence, les risques sont multiples :

Disparition de la technologie (opacité).

Confusion entre le chatbot et l’être humain : absence d’anthropomorphisme dans le nom, dénomination (assistant, conseiller), le recours au « je », la voix, les expressions, le rire, les simulations d’émotions et autres, la forme du robot. L’État de Californie a imposé que soit fournie une information sur l’interaction avec un chatbot. Le robot est conçu par l’humain pour répondre à ses besoins et ses attentes, mais il lui manque la complexité.

Dans le cas d’un chatbot émotionnel, risques de dépendance, d’enfermement, de recul de la socialisation. Ce type de chatbot devrait être circonscrit à certaines finalités médicales ou éducatives encadrées et sous contrôle (surveillance, accompagnement, convalescence, éducation, divertissement).

Confiance excessive. Il importe de présenter le chatbot comme simplement un outil. Nous avons vu plus haut que certains chatbots étaient conçus pour devenir les « amis » des individus qui les utilisent. La transparence est donc indispensable : l’individu doit réaliser que le chatbot « fait semblant » de comprendre la conversation, mais en réalité il ne comprend rien.

Risques d’erreurs dans les réponses (« le lait noir »), non détection du mot-clé ou détection erronée. Les réponses sont la transparence sur les erreurs possibles, la définition d’une valeur du seuil acceptable, un mécanisme à deux passes pour la détection (une première embarquée localement – seuil bas – et une seconde haute sur le serveur.

Le caractère autoapprenant des chatbots entraîne le risque qu’ils reproduisent les biais des utilisateurs (ex : chatbot « Tay » de Microsoft avec sa logique de violence, racisme et misogynie). Les réponses sont la transparence sur le recours à l’apprentissage automatique, la transparence encore sur les biais d’apprentissage du chatbot, et un contrôle du chatbot pouvant aller jusqu’à son arrêt.

Explicabilité des réponses

Les répliques des chatbots doivent être compréhensibles et explicables.

La stratégie du chatbot correspond-t-elle à celle perçue par son interlocuteur ? Il importe d’identifier les finalités et les usages du chatbot et de communiquer sur ces derniers. Les finalités doivent être respectées. Un chatbot de surveillance doit se présenter comme tel.

Les critères des prises de décision sont-ils connus ?

Calcul des paramètres de l’interlocuteur, par exemple dans les procédures de recrutement. Les interlocuteurs doivent être informés sur les critères et les paramètres.

Enjeux de société

Le développement des chatbots en général tend à modifier les rapports humains : moins d’interactions, rapports moins tolérants, maltraitance et autoritarisme non punis, accoutumance, etc. C’est pourquoi l’utilisation des chatbots devrait être limitée à certaines finalités. Une attention particulière doit être portée aux chatbots pour les enfants en cours d’éducation. Un système d’alerte et de contrôle devrait être prévu afin, par exemple, d’alerter l’utilisateur sur sa violence et, le cas échéant, de lui interdire l’utilisation du chatbot.

D’autres risques de société sont probables, tels que l’appauvrissement du langage, la perte de mémoire, l’environnement ou encore l’ampleur du phénomène des « travailleurs du clic »[18].

Sécurité

Avec le déploiement des objets connectés (« l’internet des objets »), le foyer connecté (thermostat, station météo, ampoules connectées, etc.) devient un centre de données prisé par les hackers. Le compteur communiquant pour l’électricité simplifie grandement la vie de l’utilisateur mais il est en même temps une source d’informations inépuisable sur ses habitudes. La sécurité est donc un impératif dans ce domaine.

Un autre risque concerne la fuite et le piratage de données, notamment médicales et judiciaires. Certains cabinets d’avocats les interdisent et interdisent à leurs employés qui font du télétravail d’en avoir chez eux.

On mentionnera enfin l’« hypertrucage » (deepfake) qui désigne un enregistrement vidéo ou audio réalisé ou modifié grâce à l’intelligence artificielle. Ce terme fait référence non seulement au contenu ainsi créé, mais aussi aux technologies utilisées (le mot deepfake est une abréviation de Deep Learning et Fake pour faire référence à des contenus faux qui sont rendus profondément crédibles par l’intelligence artificielle). Des contrôles et des audits sont là nécessaires, notamment pour éviter l’usurpation d’identité (qui est une infraction pénale).

CONCLUSION

Le déploiement rapide des chatbots et l’arrivée de l’intelligence artificielle représentent une formidable opportunité pour les directions RH en vue d’améliorer les conditions de travail des collaborateurs. Ces directions doivent faire face aux nouveaux enjeux du monde de l’entreprise – attractivité, fidélisation, nouveaux modes de travail (y compris le travail à distance), responsabilité soci(ét)ale de l’entreprise, objectifs de développement durable, etc.) – et en même temps la transformation numérique dont dépend en grande partie leur pérennité.

D’une part, les chatbots de nouvelle génération peuvent permettre d’améliorer le fonctionnement de la fonction RH, par exemple en répondant aux questions des collaborateurs relatives aux ressources humaines, en fournissant une assistance dans la sélection des candidats, en améliorant le parcours de mobilité et de formation personnalisé, en analysant les zones et les facteurs d’absentéisme, en localisant les compétences.

D’autre part, ils peuvent augmenter la performance des collaborateurs en les délivrant des tâches ennuyeuses (par exemple la gestion administrative des clients, les opérations de contrôle de conformité ou de qualité, les recherches juridiques ou techniques) et en les accompagnant dans l’apprentissage de nouveaux métiers qui feront appel à des « compétences générales » (soft skills) telles que le conseil, l’empathie, l’esprit d’équipe.

Toutefois, la mutation en cours soulève des enjeux éthiques considérables qu’il convient d’identifier, d’analyser et de traiter le plus rapidement possible avant que le déploiement des chatbots dotés d’intelligence artificielle n’atteigne un point de non-retour. Ces enjeux sont considérable si l’on songe à l’importance capitale des données personnelles dans la capacité des machines à être « intelligentes », aux risques de mauvaise utilisation ou de manipulation de ces données à des fins de contrôle et de surveillance, à l’étrange transformation des chatbots en « compagnons » indispensables des collaborateurs dans les activités en ligne, et finalement à la perte de vue que la relation homme-machine n’est pas prête de remplacer les interactions, physiques ou virtuelles, entre les humains.

REFERENCES

[1] « Chatter » désigne en anglais une discussion informelle et superficielle ; « bot » est une abréviation pour « robot.

[2] https://www.lemonde.fr/pixels/article/2016/03/24/a-peine-lancee-une-intelligence-artificielle-de-microsoft-derape-sur-twitter_4889661_4408996.html

[3] En novembre 2020, l’éditeur de logiciel américain iCIMS a racheté la start-up Easyrecrue, spécialisée dans les ressources humaines, et qui en acquérant la start-up Playbots en 2018 avait pu intégrer une brique chatbot dans sa solution. Pour se démarquer dans l’univers des logiciels RH, Easyrecrue avait parié sur la communication entre l’entreprise et les talents. Elle s’est spécialisée ainsi sur les entretiens vidéo, en différé ou en live, et a développé une technologie d’analyse des comportements basée sur ces vidéos.

[4] https://www.lemondeinformatique.fr/actualites/lire-une-faille-dans-alexa-ouvre-la-porte-aux-donnees-personnelles-80041.html

[6] Plus de 7 millions de personnes ont téléchargé et essayé Replika, y compris dans des pays comme la France ou l’Italie, même si le service n’est disponible qu’en anglais.

[7] https://mental.jmir.org/2017/2/e19/

[8] https://singularityhub.com/2019/07/14/this-chatbot-has-over-660-million-users-and-it-wants-to-be-their-best-friend/

[9] https://www.adecco.fr/candidats/aloha/

[10] https://www.eurecia.com/client/3x-consultants

[11] https://mediaroom.loreal.com/fr/loreal-deploie-avec-mya-systems-une-solution-basee-sur-lia-pour-faciliter-lexperience-candidat-2/

[12] https://www.randstad.fr/randy/?utm_medium=search&utm_source=sea&utm_campaign=ran-c_promo_lancement-chatbot_0119&gclid=cj0kcqjwojx8brczarisaewbfmk7sdvnsqk5tw01xpmxjkttexysjrq10ivp7pyjf-ub5fud3o9gow0aavo3ealw_wcb

[13] RHobot, un chatbot dédié aux questions RH, a été expérimenté en 2019 par le distributeur de gaz puis étendu aux 1.279 salariés du siège francilien ; il sera déployé en 2021 vers l’ensemble des 11.000 salariés présents en France.

[14] https://www.talmundo.com/fr/onboarding-bnp-paribas-fortis-etude-de-cas

[15] https://www.ccne-ethique.fr/sites/default/files/agents-conversationnels-appel_a_contributions-cnpen_0.pdf

[16] https://www.cnil.fr/sites/default/files/atoms/files/cnil_livre-blanc-assistants-vocaux.pdf

[17] Les premiers chatbots étaient essentiellement des programmes destinés à répondre à des requêtes en se basant sur des mots dits « déclencheurs », qui permettaient de générer rapidement une réponse que les concepteurs avaient définie dans la base de données du programme. La méthode des « mots-clés » s’inspire de cette approche initiale, en permettant de donner l’impression que le chatbot « converse » avec un individu réel. Cependant, pour que cette méthode soit réellement efficace, il est important de créer une base de données imposante, faute de quoi, en raison de l’automatisme des réponses formulées, les utilisateurs s’apercevront rapidement qu’ils sont en présence d’une machine et que celle-ci ne peut satisfaire efficacement leurs attentes. C’est pourquoi aujourd’hui, sans pour autant délaisser le système de formulation de réponses à partir de mots-clés, les chatbots dotés d’IA sont capables d’apprendre, d’utiliser des systèmes de reconnaissance des mots et de réaliser des analyses linguistiques. Le but est d’être en mesure d’analyser les requêtes des utilisateurs afin de fournir des réponses exactes et satisfaisantes, imitant les comportements humains.

[18] L’intelligence artificielle n’apprend pas toute seule : l‘apprentissage des algorithmes de machine learning doit généralement être supervisé par des humains qui vont étiqueter ou légender des images (labelling and tagging), retranscrire des conversations… Les professionnels de l’IA appellent ces « micro-tâches » des HIT (human intelligence task). L’IA devait transformer notre rapport au travail et supprimer les métiers peu qualifiés. Ici, c’est le contraire qui se produit avec l’émergence d’une nouvelle forme de travail : le crowdworking (travail collaboratif). Les « crowdworkers » ou « hiters » forment une nouvelle catégorie de travailleurs, les « travailleurs du clic » indépendants et au statut précaire, qui sont payés à la tâche par des plates-formes de crowdsourcing. Facebook a reconnu qu’il faisait écouter par des sous-traitants des conversations d’usagers de son assistant vocal Alexa pour en améliorer les réponses. Google, Amazon et Apple ont admis avoir eu avoir la même pratique et, face aux critiques, ont décidé d’y mettre fin. Cf. https://www.atlantico.fr/decryptage/3571597/triche-ou-optimisation–mais-qui-sont-ces-marques-qui-utilisent-des-bataillons-de-travailleurs-du-clic–frederic-marty